|

|

Modérateurs: Modération Forum Home-Cinéma, Le Bureau de l’Association HCFR • Utilisateurs parcourant ce forum: Jigsaw et 35 invités

Tout ce qui concerne les logiciels lié au HC sur ordinateur (PC, Mac, Linux...)

Règles du forum

Avant de poster, merci de prendre connaissance des règles du forum : à lire avant de poster

Avant de poster, merci de prendre connaissance des règles du forum : à lire avant de poster

PCHC avec Avisynth+ & pixel shaders

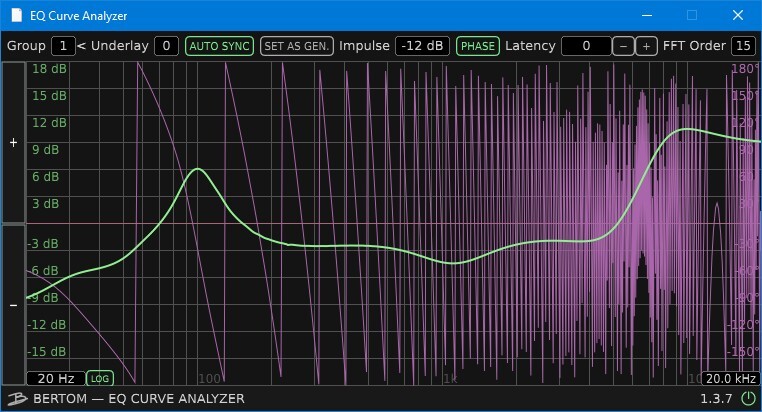

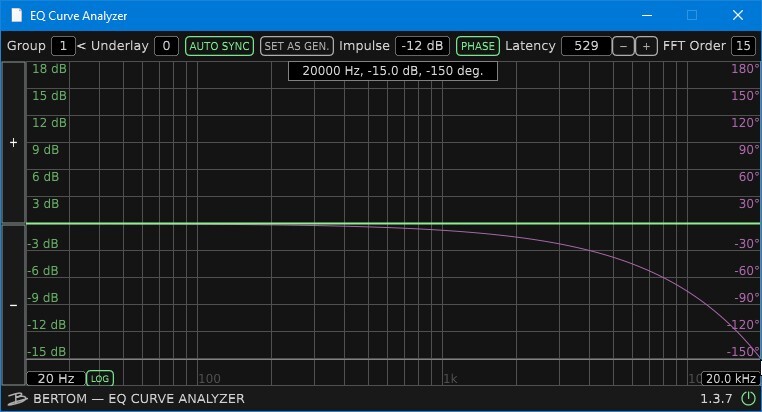

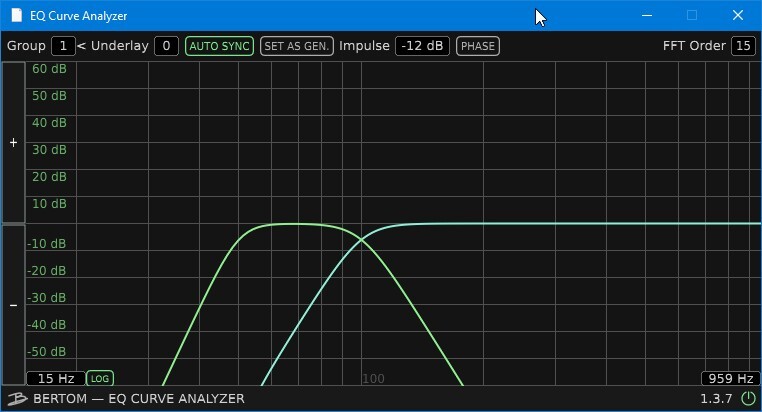

Voici la phase qu'on obtient si on ne compense pas pdt l'analyse fréq. les retards induits par la chaine de traitement (latency mis à zéro)

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

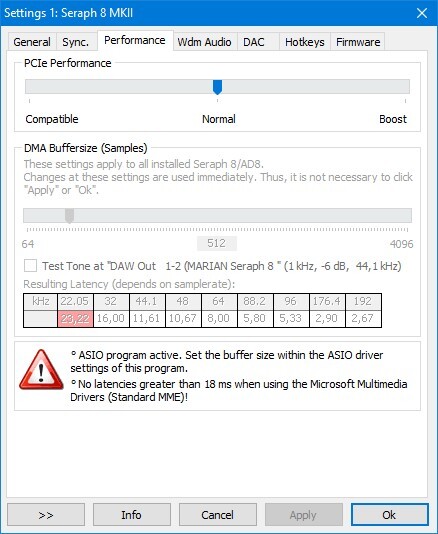

Ce retard est néanmoins constant et correspond au réglage de la taille des buffers audio dans Usine.

Pour être totalement précis, qd on paramètre cette taille dans Usine, Usine répercute en fait ce paramètre sur le driver ASIO qui impose cette taille au buffer de la CS. Cette valeur est alors affichée de manière grisée dans le soft de config de la carte son car elle n'est pas modifiable tant que Usine à la main sur le driver ASIO.

Qd on ferme Usine, le buffer de la CS retrouve sa valeur initiale (qui peut à nouveau être modifiée).

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

Par curiosité, on peut s'interroger sur ce que vaut la phase induite par un retard de 1 sample, 2 samples, 3 samples etc.

C'est un résultat théorique très simple. Pour 1 sample de retard, la courbe "déphasage en fonction de la fréquence f" tracée avec une échelle linéaire pour les fréquences et le déphasage, correspond à une droite qui part de 0 rad pour f = 0 Hz et qui se termine à -pi rad (-180°) pour f = fs/2 = 24000 Hz. Pour 2 samples, elle se termine à -2 x pi rad, pour n samples, elle se termine à -n x pi rad.

Donc dans le cas traité ici, le déphasage induit par les différends retards sera proportionel à la fréquence f et vaudra -530 x pi rad pour f = 24 kHz (soit -95400°) ... Par linéarité, pour f = 12 kHz qui est la moitié de 24 kHz, le déphasage vaudra -95400/2 = -47700°, etc.

Attention cependant, sur les snapshots au-dessus, l'échelle utilisée pour les fréquences n'est pas linéaire, mais en Log10. Dans ce cas, on n'a évidemment plus une droite. Ce qu'il faut néanmoins retenir, c'est que pour un retard pur, le déphasage est tjrs proportionnel à la fréquence et qu'il est donc facile à compenser qd on fait un tracé. C'est comme cela que procède le plugin.

C'est un résultat théorique très simple. Pour 1 sample de retard, la courbe "déphasage en fonction de la fréquence f" tracée avec une échelle linéaire pour les fréquences et le déphasage, correspond à une droite qui part de 0 rad pour f = 0 Hz et qui se termine à -pi rad (-180°) pour f = fs/2 = 24000 Hz. Pour 2 samples, elle se termine à -2 x pi rad, pour n samples, elle se termine à -n x pi rad.

Donc dans le cas traité ici, le déphasage induit par les différends retards sera proportionel à la fréquence f et vaudra -530 x pi rad pour f = 24 kHz (soit -95400°) ... Par linéarité, pour f = 12 kHz qui est la moitié de 24 kHz, le déphasage vaudra -95400/2 = -47700°, etc.

Attention cependant, sur les snapshots au-dessus, l'échelle utilisée pour les fréquences n'est pas linéaire, mais en Log10. Dans ce cas, on n'a évidemment plus une droite. Ce qu'il faut néanmoins retenir, c'est que pour un retard pur, le déphasage est tjrs proportionnel à la fréquence et qu'il est donc facile à compenser qd on fait un tracé. C'est comme cela que procède le plugin.

Dernière édition par Emmanuel Piat le 26 Jan 2023 8:48, édité 1 fois.

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

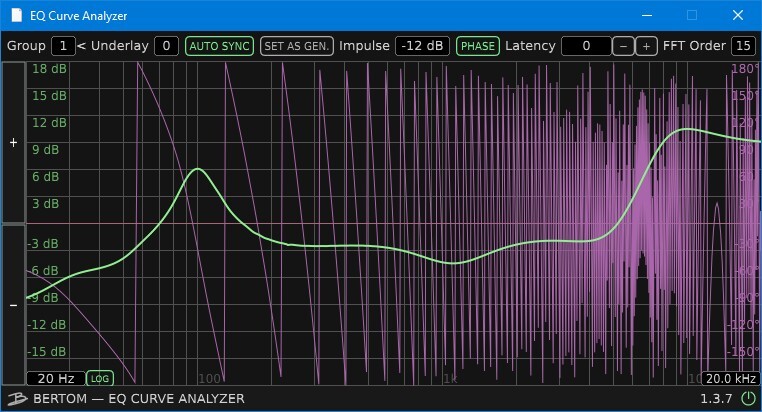

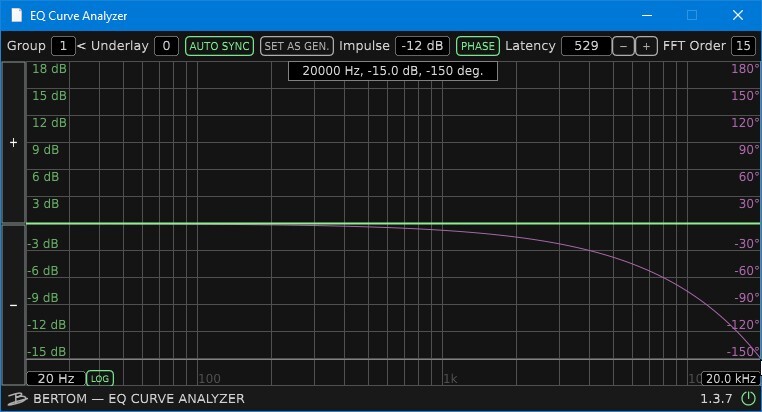

En enlevant les EQ et en mettant Latency à 529, il reste un retard de 1 sample. La courbe obtenue donne donc le déphasage induit par un retard de 1 sample en échelle Log10 pour les fréquences et en échelle linéaire pour le déphasage (courbe violette) :

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

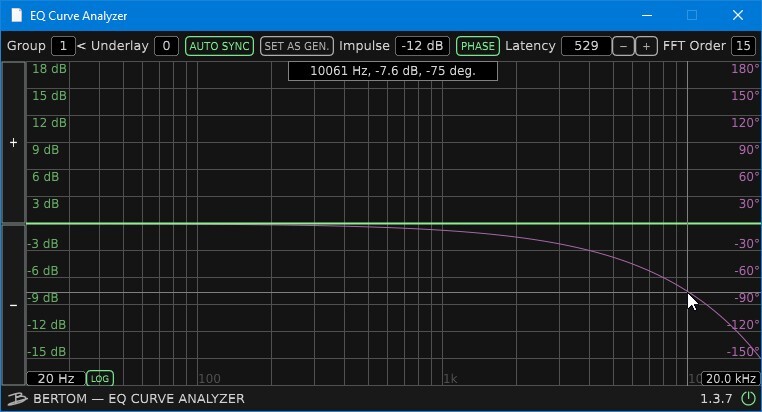

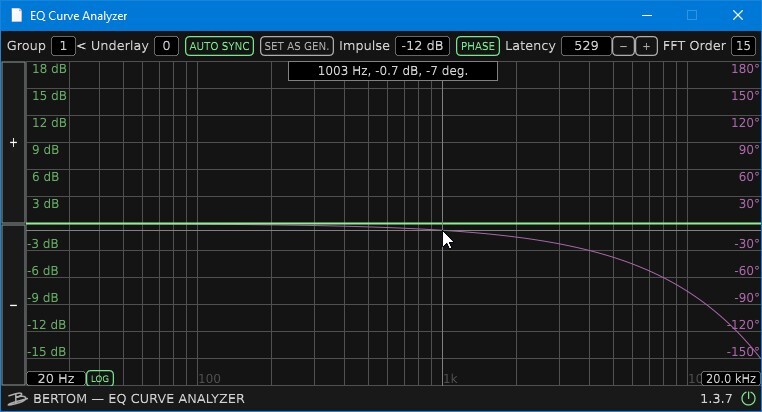

Vérifions que les valeurs sont conformes à la théorie :

Par linéarité, -180° à 24 kHz, ca fait -150° à 20 kHz, -75° à 10 kHz, -7.5° à 1 kHz, etc.

Le plugin permet d'afficher la valeur des points sur la courbe (avec des valeurs entières pour le déphasage)

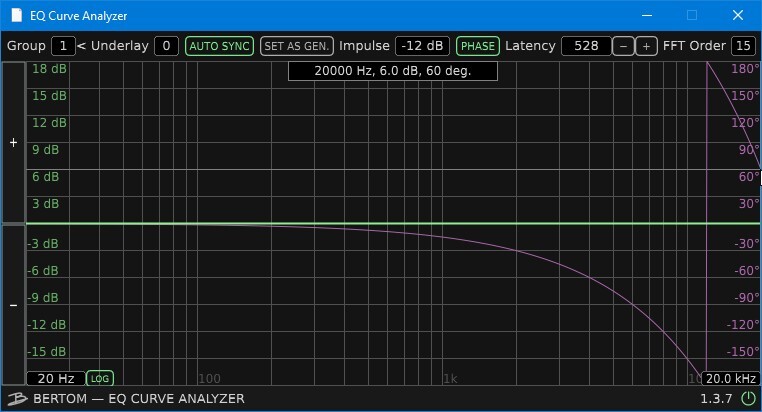

Pour 20 kHz c'est ok :

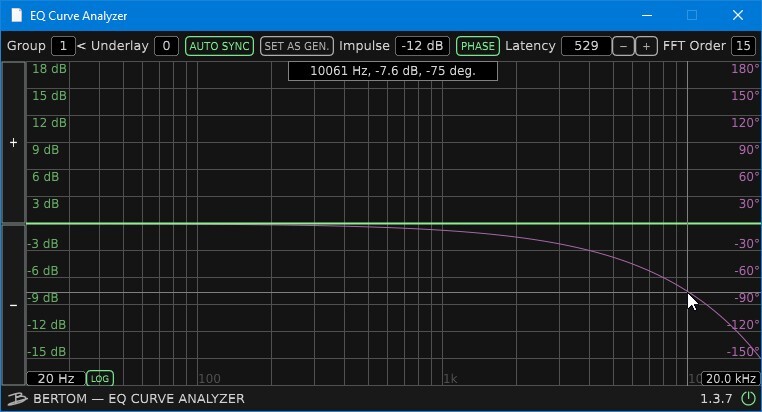

Pour 10.061 kHz (impossible d'être plus précis avec la souris) :

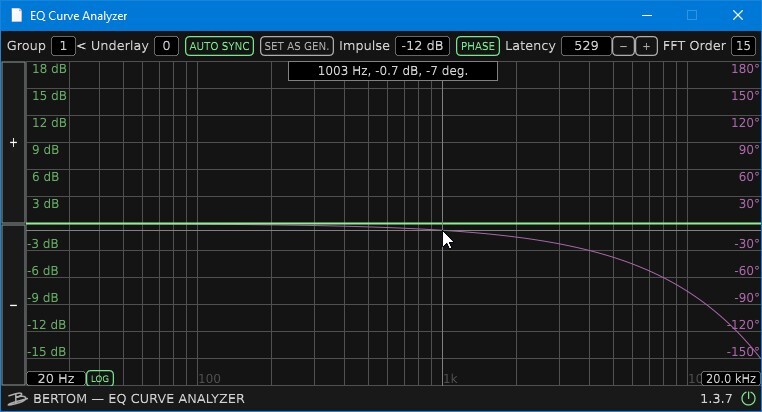

Pour 1.003 kHz :

C'est conforme

Par linéarité, -180° à 24 kHz, ca fait -150° à 20 kHz, -75° à 10 kHz, -7.5° à 1 kHz, etc.

Le plugin permet d'afficher la valeur des points sur la courbe (avec des valeurs entières pour le déphasage)

Pour 20 kHz c'est ok :

Pour 10.061 kHz (impossible d'être plus précis avec la souris) :

Pour 1.003 kHz :

C'est conforme

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

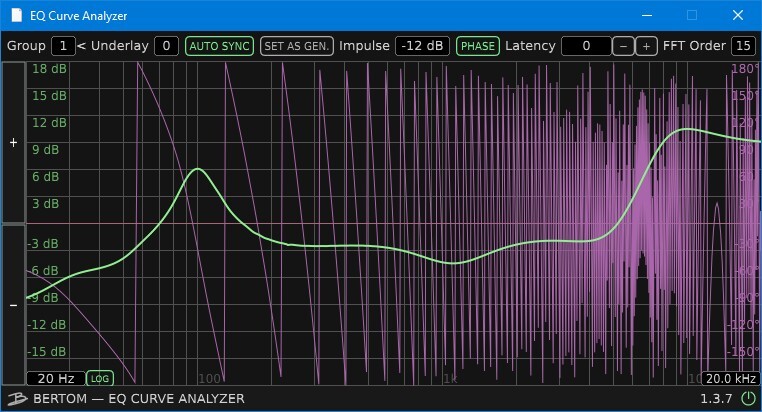

Pour un retard de 2 samples, on aura à 24 kHz un retard de 2 x (-180°) = -360° = 0° car la phase est exprimée modulo 2pi.

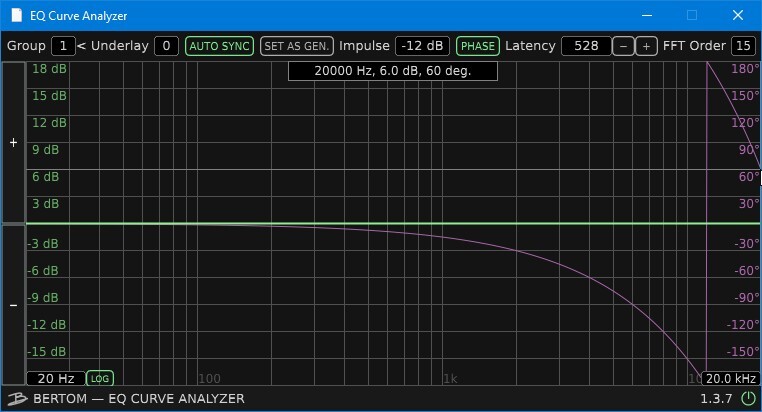

Dans ce cas, à 20 kHz, on aura -300°, soit +60° si on ajoute 360° . On retrouve bien ces valeurs si on met latency à 528 pour avoir un retard de 2 samples :

etc.

Dans ce cas, à 20 kHz, on aura -300°, soit +60° si on ajoute 360° . On retrouve bien ces valeurs si on met latency à 528 pour avoir un retard de 2 samples :

etc.

Dernière édition par Emmanuel Piat le 26 Jan 2023 9:29, édité 1 fois.

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

Ca rappelle des souvenirs à certains ?

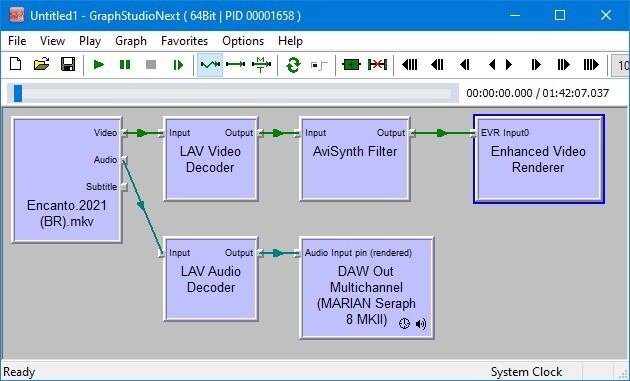

C'était la grande époque de la découverte des filtres DirectShow avec Graphedit du temps du DVD quand on installait des applis commerciales payantes de lecture de DVD (WinDVD and co) puis qu'on "détournait" ensuite leur filtres DirectShow de décodage audio et vidéo pour les réutiliser gratuitement dans ZoomPlayer ... Nostalgie ...

... Nostalgie ...

Ca fonctionne correctement : les traitements Avisynth+ sont actifs via le filtre AViSynth Filter. En mettant le filtre DirectShow d'une carte de capture en source, on pourrait donc traiter un flux vidéo entrant externe (proc vidéo) ... Par contre, si on met comme renderer video MPC Video Renderer, on n'a pas de fenêtre d'image qui apparait ... C'est balot . Je n'ai pas essayé avec madVR (il n'est pas installé sur ce PC). En EVR, ça sort en limited range ... Bref, avec un soft de capture qui accepte d'insérer des filtres DS ds le graph de rendu et qui soit compatible avec MPC-VR, on pourrait se faire un proc vidéo basé sur avisynth+ sans passer par la case madVR et faire du DTM ... Ceci dit, je n'ai rien contre Madshi hein

. Je n'ai pas essayé avec madVR (il n'est pas installé sur ce PC). En EVR, ça sort en limited range ... Bref, avec un soft de capture qui accepte d'insérer des filtres DS ds le graph de rendu et qui soit compatible avec MPC-VR, on pourrait se faire un proc vidéo basé sur avisynth+ sans passer par la case madVR et faire du DTM ... Ceci dit, je n'ai rien contre Madshi hein  ...

...

C'était la grande époque de la découverte des filtres DirectShow avec Graphedit du temps du DVD quand on installait des applis commerciales payantes de lecture de DVD (WinDVD and co) puis qu'on "détournait" ensuite leur filtres DirectShow de décodage audio et vidéo pour les réutiliser gratuitement dans ZoomPlayer

Ca fonctionne correctement : les traitements Avisynth+ sont actifs via le filtre AViSynth Filter. En mettant le filtre DirectShow d'une carte de capture en source, on pourrait donc traiter un flux vidéo entrant externe (proc vidéo) ... Par contre, si on met comme renderer video MPC Video Renderer, on n'a pas de fenêtre d'image qui apparait ... C'est balot

Dernière édition par Emmanuel Piat le 26 Jan 2023 0:46, édité 8 fois.

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

Avec MPC-HC, il y en a qui ont déjà essayé d'utiliser "Fichier/Ouvrir un périphérique ..." avec une carte de capture vidéo pour lire un flux vidéo externe ? Je me demande si ça marche ... Car ensuite, on fait ce qu'on veut en terme de post-processing CPU/GPU ...

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

Alors NON mais si cela fonctionne, je ne comprendrai pas l'apport de Vidéoprocessor quand on veut transformer son PC en lecteur media multi source (via une carte d'acquisition)

La configuration dans mon profil

PCHC madVR / Epson LS12000 / Microperf Screenline 2m82 / Bi-Amp BMS12S305+RCF ND650 /Sub Beyma 18" et JBL GTI15 / JBL Arena 120 surround (8) et back (2) / Lab Gruppen C10:8X et C16:4 / Crest 8001 / Filtrage BLU100+BLU BOB2+BLU USB / ASIO

-

Polopretress - Contributeur HCFR & Modérateur Installations

- Messages: 14408

- Inscription Forum: 08 Jan 2016 1:48

- Localisation: Val d'Oise

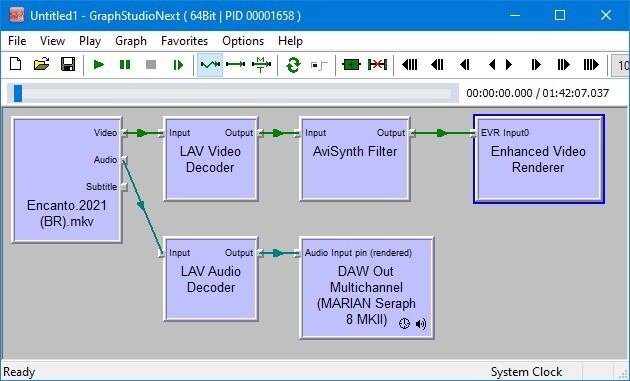

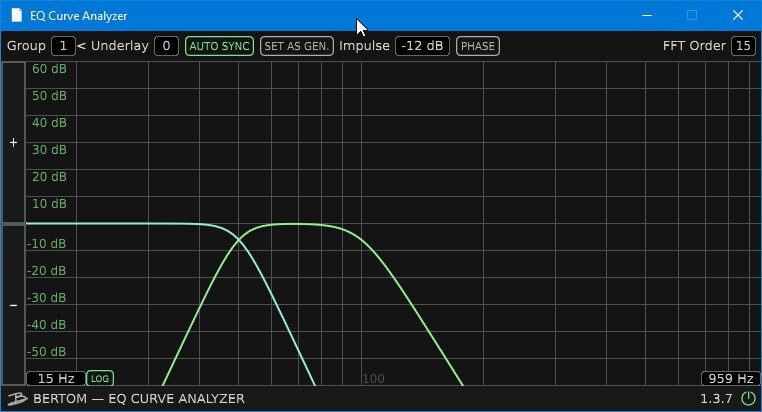

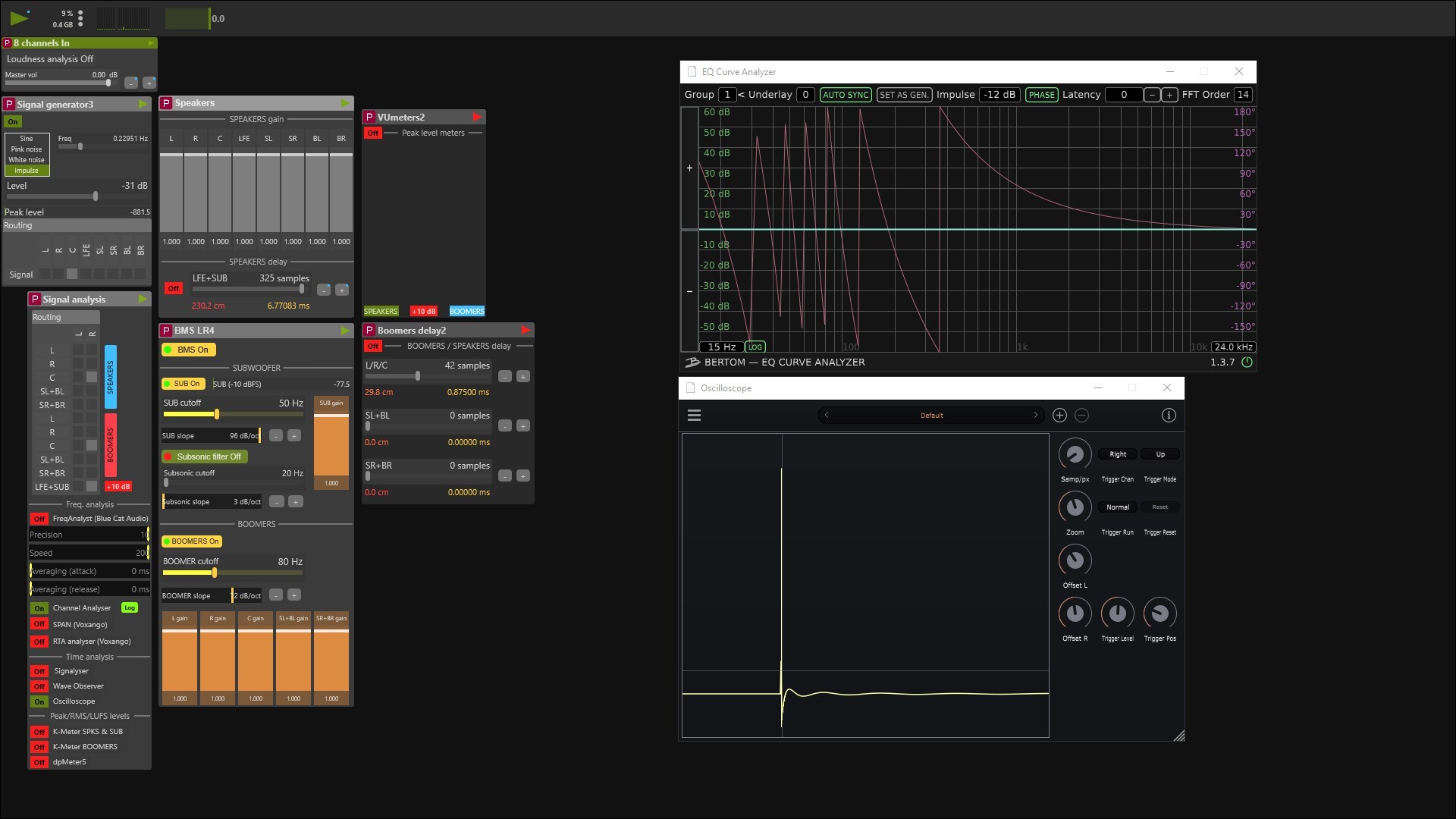

Grâce à l'intégration du générateur impulsionnel du VST "EQ Curve Analyser" dans l'interface de Usine, je peux maintenant faire une analyse spectrale propre de la transformation fréquentielle qui s'opère dans chaque canal. Voici une petite illustration.

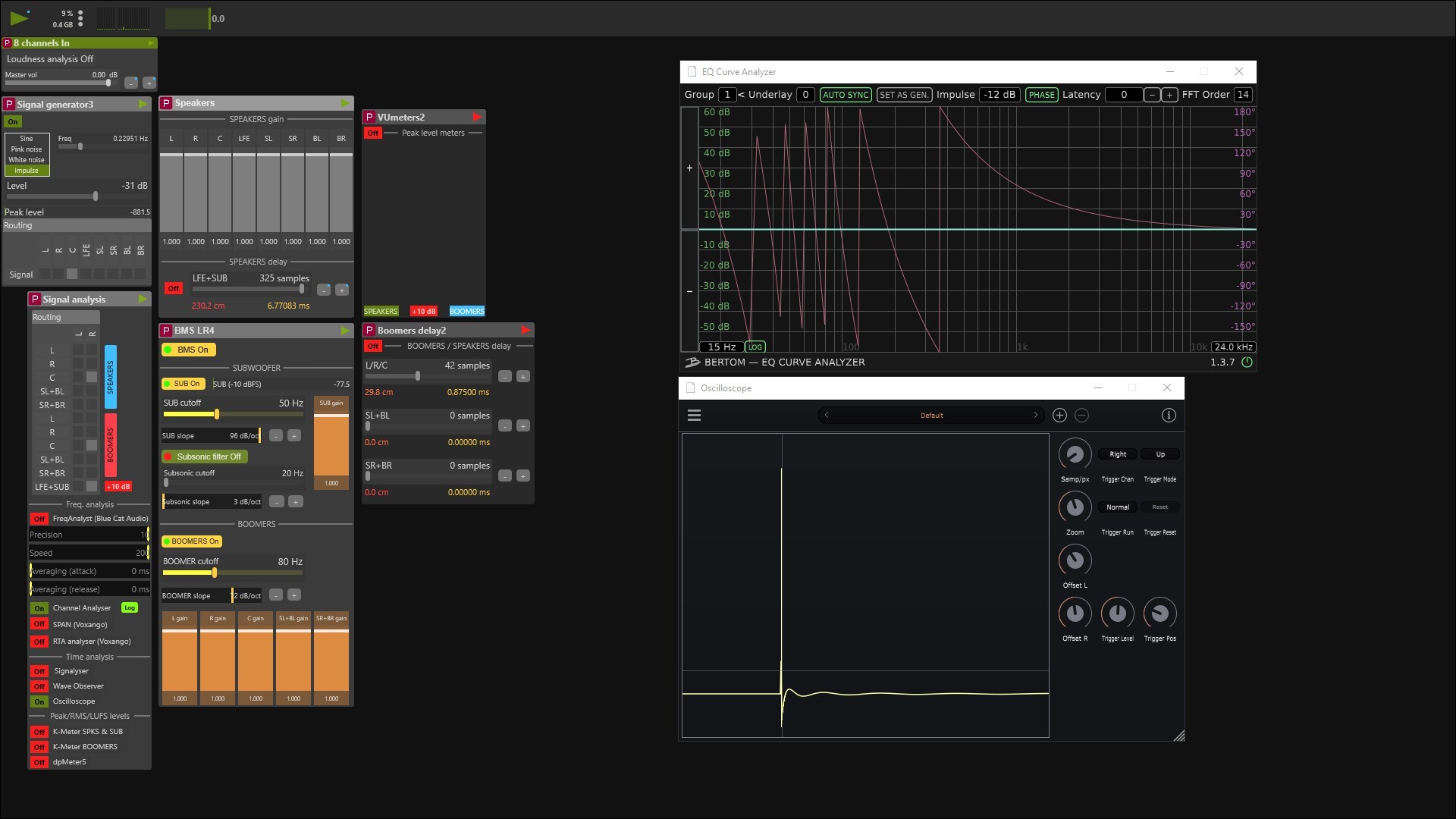

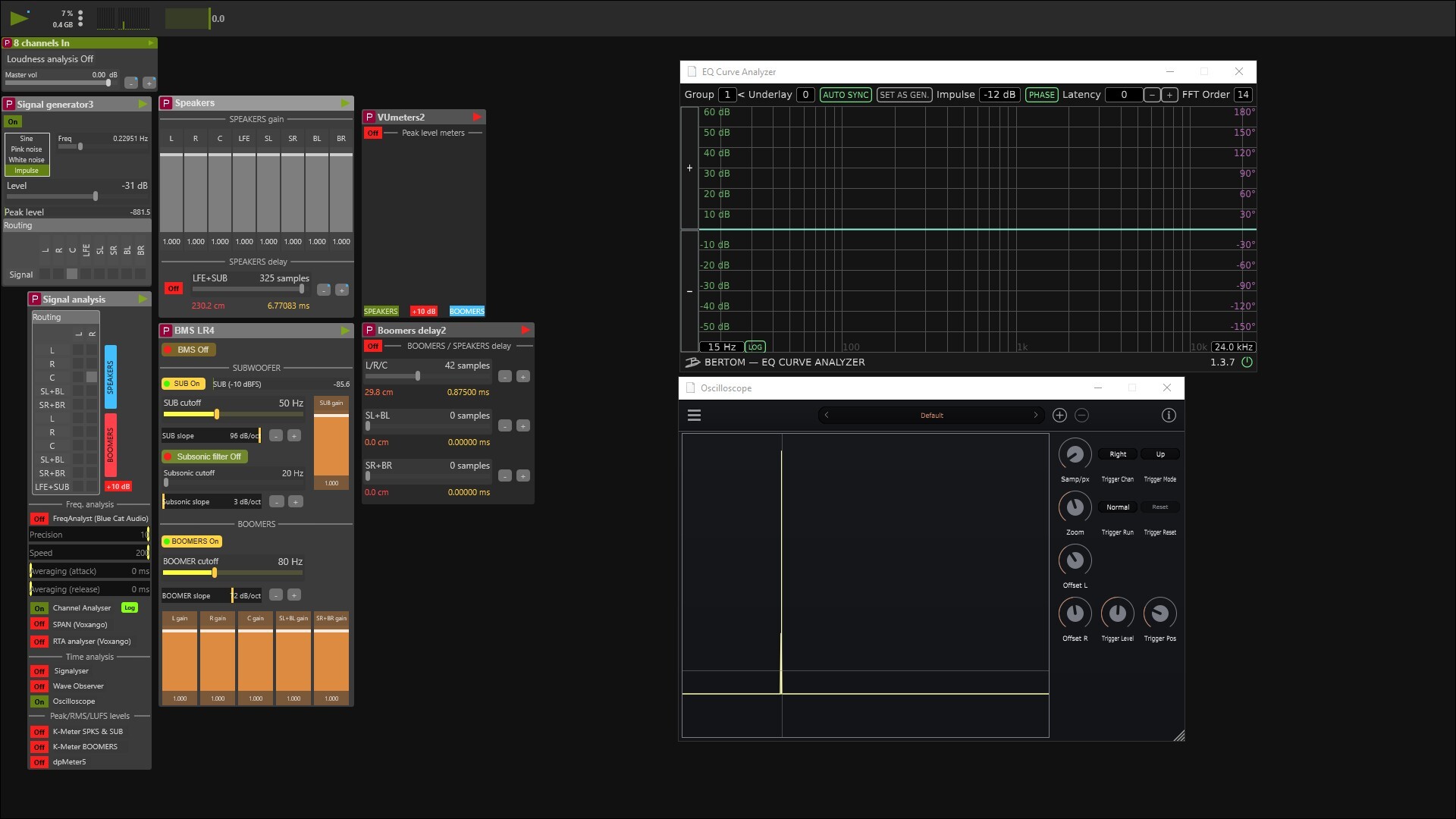

Si le BMS est sur off, et que je génère le train d'impulsions en entrée sur le canal C (voir le géné en haut à gauche), puis que je demande à "EQ Curve Analyser" d'analyser ce même canal C en sortie d'Usine, on obtient un filtre passe-tout à 0 dB avec une phase nulle de 15 Hz à 24 kHz. C'est normal, car on a C OUT = C IN. L'oscillo qui affiche la sortie opère en mode triggé pour détecter le front montant d'une impulsion et synchronise son affichage dessus. On voit donc bien l'impulsion qui ressort de Usine à cet instant.

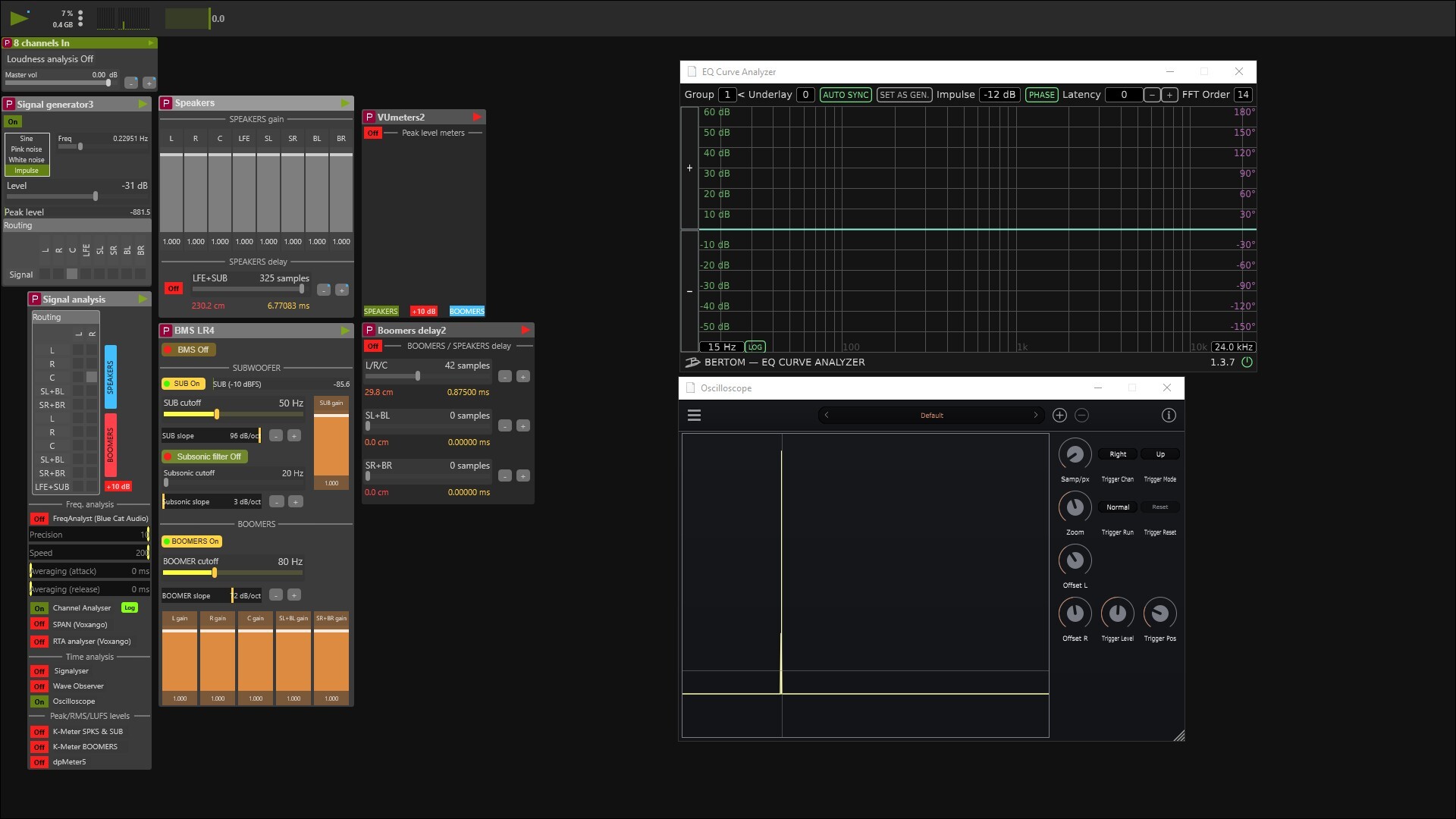

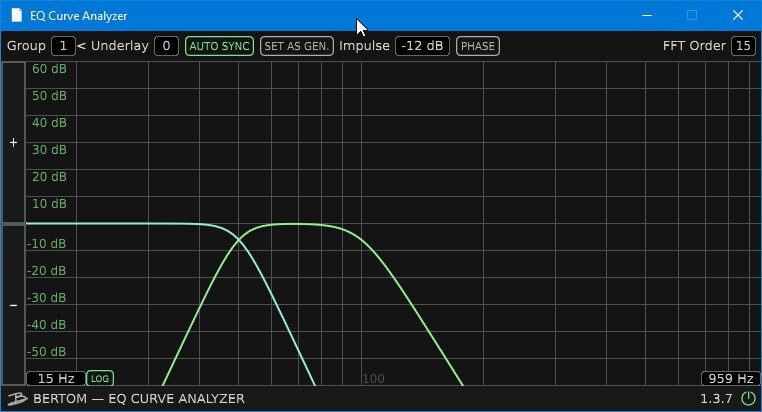

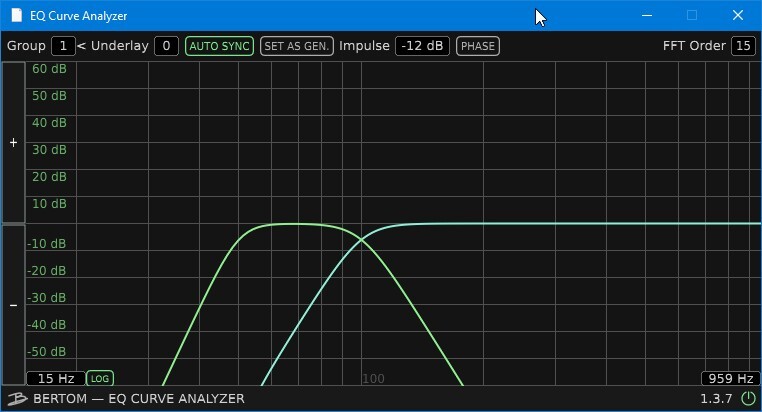

Maintenant, j'active le BMS avec les paramètres de filtrage qu'on voit sur le snapshot. Le canal C est traité par des filtres de type LR pour avoir 3 bandes : SUB - BOOMER - SPEAKER. Si on affiche ces bandes 2 par 2 avec EQ Curve Analyser, ça donne :

Contrairement à ce que j'avais avant avec SPAN, les courbes ne bougent plus d'un iota. Je trouve juste dommage qu'on ne puisse pas aller en deça de -60 dB pour l'échelle... Si maintenant, avec le rooting de l'analyse (cf. en bas à gauche sur le snapshoot suivant), j'additionne SUB + BOOMER + SPEAKER pour simuler la recombinaison de chaque bande qui sera émise par les HP, EQ Curve Analyser montre qu'avec cette somme on a toujours un filtre passe-tout à 0 dB mais que maintenant la phase n'est plus nulle. Cette phase non nulle se traduit alors sur l'oscilloscope dans le domaine temporel par une déformation de l'impulsion qui sera reconstruite par les HP. L'impulsion a maintenant un post-ringing :

Est-ce que ce post-riging s'entend ? Vaste question qui a fait couler bcp d'encre ... Pour autant que je puisse en juger, au casque, en écoute comparative en downmix stéréo du flux multicanal avec ou sans BMS, c'est du domaine du très subtil La première chose à comprendre, c'est que ces 3 signaux vont ensuite transiter dans des DAC, éventuellement dans des filtres analogiques actifs pour le SPEAKER, puis dans des électroniques de puissance (amplis) puis dans des HP, puis dans une salle, puis enfin se recombiner dans le canal auditif des oreilles d'un spectateur dont l'emplacement ne sera pas forcément équidistant à chaque HP ... Chacun de ces maillons va donc ajouter une signature au signal et sur certaines bandes de fréquence, ces signatures pourront être franchement marquées ... Donc, il faut raison garder ... Si on juge que l'apport d'un HP supplémentaire sur le rendu est supérieur aux défauts induits par la détermination de la bande de fréquence qui va l'alimenter, ce sera évidemment bénéfique pour l'écoute une fois le système correctement réglé.

La première chose à comprendre, c'est que ces 3 signaux vont ensuite transiter dans des DAC, éventuellement dans des filtres analogiques actifs pour le SPEAKER, puis dans des électroniques de puissance (amplis) puis dans des HP, puis dans une salle, puis enfin se recombiner dans le canal auditif des oreilles d'un spectateur dont l'emplacement ne sera pas forcément équidistant à chaque HP ... Chacun de ces maillons va donc ajouter une signature au signal et sur certaines bandes de fréquence, ces signatures pourront être franchement marquées ... Donc, il faut raison garder ... Si on juge que l'apport d'un HP supplémentaire sur le rendu est supérieur aux défauts induits par la détermination de la bande de fréquence qui va l'alimenter, ce sera évidemment bénéfique pour l'écoute une fois le système correctement réglé.

Plutôt que de filtrer en IIR, on aurait aussi pu mettre des filtres FIR à phase linéaire via des VST dédiés. Dans ce cas, on n'aura plus de déphasage mais on aura du pré-ringing avant l'impulsion et du post ringing après (+ une latence supplémentaire) ... Et le pré-ringing, dans certains cas, n'est pas neutre. Il n'y a pas de miracle ... On trouve sur YT des vidéos d'ingé son qui comparent les mêmes EQ FIR à phase linéaire et IIR à phase minimale et qui font écouter le résultat. Tous ces EQ ont des "défauts" qui peuvent devenir entendable sur certains types de message sonore ... L'avis qui prédomine aujourd'hui en mastering audio, c'est qu'en fonction de la nature du son qu'on veut façonner par EQ, on prendra la typologie de filtrage qui s'adapte le mieux et ça peut être autant de l'IIR que du FIR. C'est d'ailleurs pour cela que les VST pro d'EQ intègrent maintenant les deux.

Si le BMS est sur off, et que je génère le train d'impulsions en entrée sur le canal C (voir le géné en haut à gauche), puis que je demande à "EQ Curve Analyser" d'analyser ce même canal C en sortie d'Usine, on obtient un filtre passe-tout à 0 dB avec une phase nulle de 15 Hz à 24 kHz. C'est normal, car on a C OUT = C IN. L'oscillo qui affiche la sortie opère en mode triggé pour détecter le front montant d'une impulsion et synchronise son affichage dessus. On voit donc bien l'impulsion qui ressort de Usine à cet instant.

Maintenant, j'active le BMS avec les paramètres de filtrage qu'on voit sur le snapshot. Le canal C est traité par des filtres de type LR pour avoir 3 bandes : SUB - BOOMER - SPEAKER. Si on affiche ces bandes 2 par 2 avec EQ Curve Analyser, ça donne :

Contrairement à ce que j'avais avant avec SPAN, les courbes ne bougent plus d'un iota. Je trouve juste dommage qu'on ne puisse pas aller en deça de -60 dB pour l'échelle... Si maintenant, avec le rooting de l'analyse (cf. en bas à gauche sur le snapshoot suivant), j'additionne SUB + BOOMER + SPEAKER pour simuler la recombinaison de chaque bande qui sera émise par les HP, EQ Curve Analyser montre qu'avec cette somme on a toujours un filtre passe-tout à 0 dB mais que maintenant la phase n'est plus nulle. Cette phase non nulle se traduit alors sur l'oscilloscope dans le domaine temporel par une déformation de l'impulsion qui sera reconstruite par les HP. L'impulsion a maintenant un post-ringing :

Est-ce que ce post-riging s'entend ? Vaste question qui a fait couler bcp d'encre ... Pour autant que je puisse en juger, au casque, en écoute comparative en downmix stéréo du flux multicanal avec ou sans BMS, c'est du domaine du très subtil

Plutôt que de filtrer en IIR, on aurait aussi pu mettre des filtres FIR à phase linéaire via des VST dédiés. Dans ce cas, on n'aura plus de déphasage mais on aura du pré-ringing avant l'impulsion et du post ringing après (+ une latence supplémentaire) ... Et le pré-ringing, dans certains cas, n'est pas neutre. Il n'y a pas de miracle ... On trouve sur YT des vidéos d'ingé son qui comparent les mêmes EQ FIR à phase linéaire et IIR à phase minimale et qui font écouter le résultat. Tous ces EQ ont des "défauts" qui peuvent devenir entendable sur certains types de message sonore ... L'avis qui prédomine aujourd'hui en mastering audio, c'est qu'en fonction de la nature du son qu'on veut façonner par EQ, on prendra la typologie de filtrage qui s'adapte le mieux et ça peut être autant de l'IIR que du FIR. C'est d'ailleurs pour cela que les VST pro d'EQ intègrent maintenant les deux.

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

Voici maintenant un petit apparté concernant le rendu au casque et la virtualisation d'une source sonore multicanal.

En ce qui me concerne le sujet est loin d'être anecdotique car il peut concerner pas mal d'usages.

Déjà si on débute et qu'on a juste un PC mais pas de système audio, le casque peut être une solution low cost intéressante pour démarrer dans l'univers du son. On peut commencer avec le chipset intégré à la CM, puis investir ds un petit DAC USB "budget" intégrant un ampli casque et ça sera déjà très très bien. Si on veut ensuite évoluer vers un système multicanal avec des HP et qu'on décide de rester dans une démarche de type home studio, on peut acheter une CS pro multicanal puis processer soi même le flux audio via Usine et alterner entre enceintes et casque. Personnellement, c'est comme ça que j'ai démarré. J'ai acheté un casque, un ampli casque et une CS pro et l'aventure ne s'est jamais arrêtée ... J'ai tjrs mon casque et je l'utilise encore quotidiennement (Sony MDR CD2000 qui est un casque ouvert ultra confortable. Je l'ai souvent sur les oreilles 8h/jour ... Avec le temps, j'ai dû recoller ses membranes qui commençaient à se décoller, ce qui générait de la distorsion. Depuis, il est comme neuf et il me procure tjrs autant de plaisir qu'il y a presque 20 ans ...).

Ensuite le casque garde tout son intérêt pour les écoutes nocturnes tardives qd on ne veut pas déranger. Et évidemment, pour du PCHC nomade avec un laptop, c'est un élément essentiel. Ca permet d'emmener un HC partout avec soi. Dans les avantages d'un bon casque, il y a aussi le côté dynamique et la précision du rendu audio. Dans les inconvénients il y a l'image sonore qui est très restreinte et ceci est particulièrement criant dans un contexte de rendu multicanal ... Pour amoindrir cela, on trouve des tas de plugins VST qui appartiennent à la catégorie "Headphone mixing plugins". Tous permettent de simuler le rendu d'environnements acoustiques de mixage. Voici les plus connus :

https://theproaudiofiles.com/mixing-with-headphones/

Ces solutions ont un coût qui peut être élevé... Mais on a parfois des ristournes importantes comme pour Wave Nx qui est à $30 en ce moment :

https://www.waves.com/plugins/nx#introd ... l-mix-room

Néanmoins, si on souhaite rester dans le domaine du gratuit, on peut tout à fait se construire soit même sa virtualisation pour casque audio et ça fonctionne franchement pas mal. C'est en tout cas bien mieux que la solution Dolby Headphone qui était intégrée du temps des DVD dans le décodeur audio multicanal AC3 et DTS de nvidia (excellent décodeur que j'utilisais personnellement). A mes oreilles, le pb du Dolby headphone, c'était la perte évidente de dynamique et une spacialisation un peu trop timorée en small room et trop peu précise, voir carrément brouillonne sur les salles + grandes. J'espère que Dolby a depuis amélioré ses algos car on peut faire bcp mieux.

Qd j'aurais un peu de temps cette semaine, je vous montrerai mon approche ds Usine qui est basée sur le moteur exploité par Dear Reality, lequel utilise la techno Seinnheser AMBEO qui est probablement basée sur de l'ambisonic. Leur produit phare de virtualisation est dearVR MONITOR :

https://www.dear-reality.com/products/dearvr-monitor

C'est évidemment un produit complet capable de s'adapter à tous les flux multicanaux en studio. Mais si on reste bcp + basique, on peut se contenter d'exploiter une version light gratuite de ce moteur de virtualisation qui est présent dans le plugin DearVR MICRO :

https://www.dear-reality.com/products/dearvr-micro

Avec ce plugin, on peut uniqt processer un flux mono ou stéréo pour replacer pour un casque en binaural la source dans le plan horizontal et en hauteur dans un environnement virtuel qu'on peut paramétrer. Comme un flux multicanal n'est jamais qu'un ensemble de flux mono, c'est très simple d'intégrer ds Usine 6 VST DearVR pour virtualiser 5.1 canaux ... Le résultat est intéressant. Avec un bon paramétrage il n'y a pas de perte de dynamique. Même si on n'a pas du tout le rendu spatial d'un vrai système multicanal, le son s'externalise de manière assez convaincante autour de la tête et ça colle plutôt bien avec la taille d'un écran d'ordi. Une fois qu'on y a gouté, c'est impossible de revenir en arrière. La commutation avec un bouton sous Usine entre un downmix 2.0 standard et la virtualisation est cruelle.

En ce qui me concerne le sujet est loin d'être anecdotique car il peut concerner pas mal d'usages.

Déjà si on débute et qu'on a juste un PC mais pas de système audio, le casque peut être une solution low cost intéressante pour démarrer dans l'univers du son. On peut commencer avec le chipset intégré à la CM, puis investir ds un petit DAC USB "budget" intégrant un ampli casque et ça sera déjà très très bien. Si on veut ensuite évoluer vers un système multicanal avec des HP et qu'on décide de rester dans une démarche de type home studio, on peut acheter une CS pro multicanal puis processer soi même le flux audio via Usine et alterner entre enceintes et casque. Personnellement, c'est comme ça que j'ai démarré. J'ai acheté un casque, un ampli casque et une CS pro et l'aventure ne s'est jamais arrêtée ... J'ai tjrs mon casque et je l'utilise encore quotidiennement (Sony MDR CD2000 qui est un casque ouvert ultra confortable. Je l'ai souvent sur les oreilles 8h/jour ... Avec le temps, j'ai dû recoller ses membranes qui commençaient à se décoller, ce qui générait de la distorsion. Depuis, il est comme neuf et il me procure tjrs autant de plaisir qu'il y a presque 20 ans ...).

Ensuite le casque garde tout son intérêt pour les écoutes nocturnes tardives qd on ne veut pas déranger. Et évidemment, pour du PCHC nomade avec un laptop, c'est un élément essentiel. Ca permet d'emmener un HC partout avec soi. Dans les avantages d'un bon casque, il y a aussi le côté dynamique et la précision du rendu audio. Dans les inconvénients il y a l'image sonore qui est très restreinte et ceci est particulièrement criant dans un contexte de rendu multicanal ... Pour amoindrir cela, on trouve des tas de plugins VST qui appartiennent à la catégorie "Headphone mixing plugins". Tous permettent de simuler le rendu d'environnements acoustiques de mixage. Voici les plus connus :

https://theproaudiofiles.com/mixing-with-headphones/

Ces solutions ont un coût qui peut être élevé... Mais on a parfois des ristournes importantes comme pour Wave Nx qui est à $30 en ce moment :

https://www.waves.com/plugins/nx#introd ... l-mix-room

Néanmoins, si on souhaite rester dans le domaine du gratuit, on peut tout à fait se construire soit même sa virtualisation pour casque audio et ça fonctionne franchement pas mal. C'est en tout cas bien mieux que la solution Dolby Headphone qui était intégrée du temps des DVD dans le décodeur audio multicanal AC3 et DTS de nvidia (excellent décodeur que j'utilisais personnellement). A mes oreilles, le pb du Dolby headphone, c'était la perte évidente de dynamique et une spacialisation un peu trop timorée en small room et trop peu précise, voir carrément brouillonne sur les salles + grandes. J'espère que Dolby a depuis amélioré ses algos car on peut faire bcp mieux.

Qd j'aurais un peu de temps cette semaine, je vous montrerai mon approche ds Usine qui est basée sur le moteur exploité par Dear Reality, lequel utilise la techno Seinnheser AMBEO qui est probablement basée sur de l'ambisonic. Leur produit phare de virtualisation est dearVR MONITOR :

https://www.dear-reality.com/products/dearvr-monitor

C'est évidemment un produit complet capable de s'adapter à tous les flux multicanaux en studio. Mais si on reste bcp + basique, on peut se contenter d'exploiter une version light gratuite de ce moteur de virtualisation qui est présent dans le plugin DearVR MICRO :

https://www.dear-reality.com/products/dearvr-micro

Avec ce plugin, on peut uniqt processer un flux mono ou stéréo pour replacer pour un casque en binaural la source dans le plan horizontal et en hauteur dans un environnement virtuel qu'on peut paramétrer. Comme un flux multicanal n'est jamais qu'un ensemble de flux mono, c'est très simple d'intégrer ds Usine 6 VST DearVR pour virtualiser 5.1 canaux ... Le résultat est intéressant. Avec un bon paramétrage il n'y a pas de perte de dynamique. Même si on n'a pas du tout le rendu spatial d'un vrai système multicanal, le son s'externalise de manière assez convaincante autour de la tête et ça colle plutôt bien avec la taille d'un écran d'ordi. Une fois qu'on y a gouté, c'est impossible de revenir en arrière. La commutation avec un bouton sous Usine entre un downmix 2.0 standard et la virtualisation est cruelle.

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

A noter que ce VST de virtualisation binaurale également gratuit fonctionne en x64, donc est compatible avec un host comme Usine :

https://www.auburnsounds.com/products/Panagement.html

Il a bcp plus de param de réglages ... A voir.

Celui-ci est par contre en x86 seulement, donc incompatible avec Usine, c'est dommage :

http://anaglyph.dalembert.upmc.fr/

https://www.auburnsounds.com/products/Panagement.html

Il a bcp plus de param de réglages ... A voir.

Celui-ci est par contre en x86 seulement, donc incompatible avec Usine, c'est dommage :

http://anaglyph.dalembert.upmc.fr/

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

Tout ce que tu montres laissent en effet entrevoir une monde de possibilités qualitatives a partir du PC.

Par contre, faut quand meme une sacré connaissance !

Par contre, faut quand meme une sacré connaissance !

La configuration dans mon profil

PCHC madVR / Epson LS12000 / Microperf Screenline 2m82 / Bi-Amp BMS12S305+RCF ND650 /Sub Beyma 18" et JBL GTI15 / JBL Arena 120 surround (8) et back (2) / Lab Gruppen C10:8X et C16:4 / Crest 8001 / Filtrage BLU100+BLU BOB2+BLU USB / ASIO

-

Polopretress - Contributeur HCFR & Modérateur Installations

- Messages: 14408

- Inscription Forum: 08 Jan 2016 1:48

- Localisation: Val d'Oise

Ca peut impressionner si on n'est pas familier avec ces concepts de filtrage numérique mais AMHA, utiliser Usine est par exemple bcp + simple, convivial et puissant qu'utiliser JRiver pour faire du filtrage et du bass managment ... En fait, si on a un minimum de bases en filtrage num, ca reste franchement basique puisqu'Usine s'appuie sur un langage graphique très intuitif (et bien fichu pour la majorité des cas de figure qu'on a à traiter en HC) qu'on peut ensuite compléter par des VST.

Je précise qu'avant de m'y mettre pdt l'été 2022, je n'avais jamais manipulé un host VST de ma vie ...

Je précise qu'avant de m'y mettre pdt l'été 2022, je n'avais jamais manipulé un host VST de ma vie ...

- Emmanuel Piat

- Contributeur HCFR 2016

- Messages: 10431

- Inscription Forum: 10 Oct 2000 2:00

- Localisation: Besançon, FRANCE

OK.

Oui moi aussi, les host vst , c'est un peu de charabia pour moi.

Personnellement, ayant basculé il y a peu sur du BSS BLU, je ne me lancerai pas sur cette appli PC.

Par contre, pour revenir a ton sujet initial, nous sommes nombreux, je pense, a vouloir tester (/se lancer) avec cette alternative a madVR en vue de comparer.

Comme proposé, ce serait super de pouvoir mettre a jour la démarche complète a partir de la première page.

(Je suis a ta dispo pour éditer tes posts)

Oui moi aussi, les host vst , c'est un peu de charabia pour moi.

Personnellement, ayant basculé il y a peu sur du BSS BLU, je ne me lancerai pas sur cette appli PC.

Par contre, pour revenir a ton sujet initial, nous sommes nombreux, je pense, a vouloir tester (/se lancer) avec cette alternative a madVR en vue de comparer.

Comme proposé, ce serait super de pouvoir mettre a jour la démarche complète a partir de la première page.

(Je suis a ta dispo pour éditer tes posts)

La configuration dans mon profil

PCHC madVR / Epson LS12000 / Microperf Screenline 2m82 / Bi-Amp BMS12S305+RCF ND650 /Sub Beyma 18" et JBL GTI15 / JBL Arena 120 surround (8) et back (2) / Lab Gruppen C10:8X et C16:4 / Crest 8001 / Filtrage BLU100+BLU BOB2+BLU USB / ASIO

-

Polopretress - Contributeur HCFR & Modérateur Installations

- Messages: 14408

- Inscription Forum: 08 Jan 2016 1:48

- Localisation: Val d'Oise

|

Retourner vers Logiciel PC Home-cinéma

|