Orange commencera la migration du cuivre vers la fibre en 2023. La transition devrait être achevée en 2030."

https://twitter.com/01net/status/1202139403579252736

https://www.01net.com/actualites/orange ... 18449.html

|

|

Modérateurs: Modération Forum Univers TV, Le Bureau de l’Association HCFR • Utilisateurs parcourant ce forum: brumos, Cool-Spot, danywilde36, Google Adsense [Bot], groot57, Jokerjol, lobs7052, Snoop91, Voad et 102 invités

Woody78 a écrit:Bonjour

Je lis souvent qu on vante les mérites des platines UHD permettant d'upscaler les BD-UHD en 12 bits

Quelqu'un pourrait m'expliquer l'intérêt de faire ça pour ensuite arriver à une TV avec une dalle 10 ?

Par exemple je vais bientôt être l'heureux possesseur d'une TV LG OLED C9 ... mais c'est une dalle 10 bits .. quel intérêt pour moi d'upscaler un signal pour qu'il soit ensuite downscaler par la TV ? Pourtant dans ces mêmes tests je lis que justement pour une TV OLED le gain amené par l'upscale en 12bits serait important et permettrait de supprimer certains défauts (de color banding ?)

Woody78 a écrit:Je vois que ce sujet a déjà été débattu ici même dans d'autres pages je vais essayer de comprendre avant de vous embêter

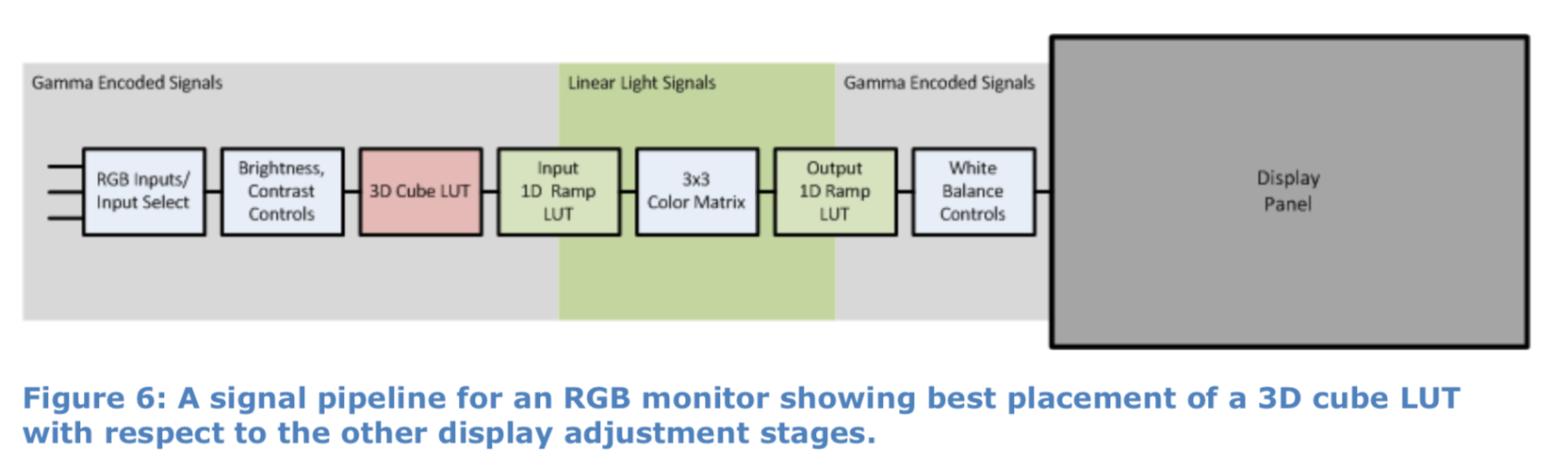

edit : donc si je comprends bien les traitements internes des TV HDG (quid de celui d'une LG C9 ?) gèrent plus que 10 bits. Et donc s'ils recoivent un signal sur 12 bits ils seraient capables de retranscrire une meilleur info en 10 bits derrière pour la dalle. J'ai bon ?

Par contre cela voudrait dire qu'il y a une forme d'IA qui va être capable de prendre les meilleurs info (à hauteur de 10 bits) encodés dans le flux 12 ?! Et donc permettre d'avoir un résultat plus adapté aux caractéristiques de la dalle

Woody78 a écrit:Je vois que ce sujet a déjà été débattu ici même dans d'autres pages je vais essayer de comprendre avant de vous embêter

edit : donc si je comprends bien les traitements internes des TV HDG (quid de celui d'une LG C9 ?) gèrent plus que 10 bits. Et donc s'ils recoivent un signal sur 12 bits ils seraient capables de retranscrire une meilleur info en 10 bits derrière pour la dalle. J'ai bon ?

Par contre cela voudrait dire qu'il y a une forme d'IA qui va être capable de prendre les meilleurs info (à hauteur de 10 bits) encodés dans le flux 12 ?! Et donc permettre d'avoir un résultat plus adapté aux caractéristiques de la dalle

Woody78 a écrit:Merci pour le retour

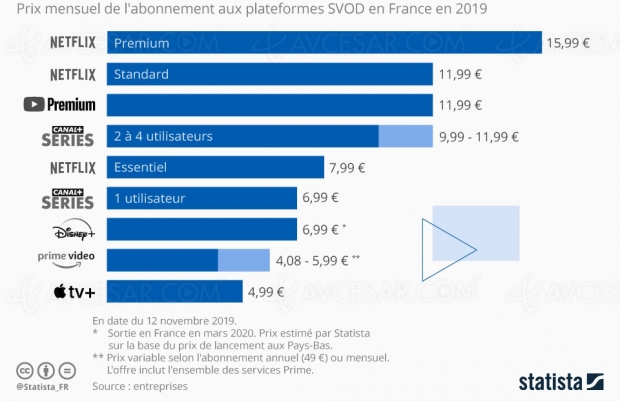

Puisque ça cause SVOD, je suis intéressé par MyCanal afin de me débarrasser définitivement de ma box pourrie SFR fibre (même pas 4K)

Idéalement je voudrai passer par mon HTPC et l'application MyCanal W10 (ou MyCanal web) mais savez vous si on a le droit à la 4K/HDR par ce biais ?

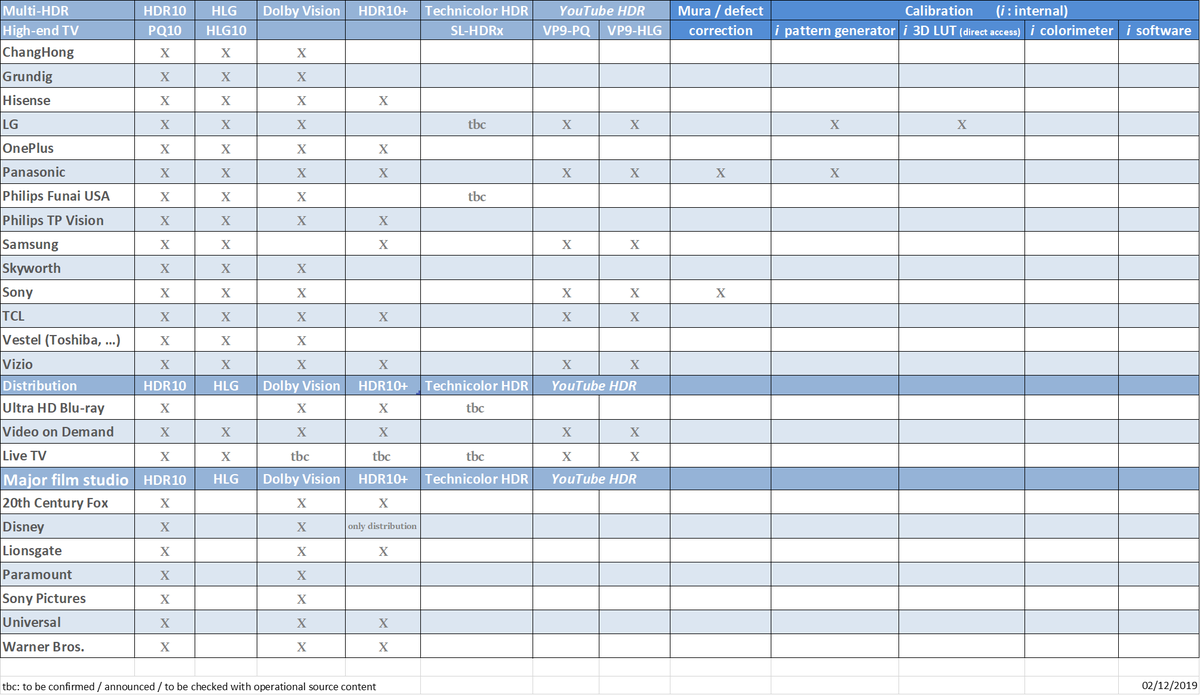

Apparemment MyCanal diffuserait en 4K que sur Apple TV/décodeurs et Samsung TV et je ne trouve pas d'info sur l'HDR et le DV

Autre chose, Canal Séries permet il de recevoir les chaines TNT sur MyCanal ?

Et enfin Canal Séries est il inclus avec l'offre Canal+ de base (c+/décalé) .. j'ai l'impression que c'est uniquement inclus dans l'offre -26 ans

Crazy V a écrit:Saurais-tu m'éclairer sur le "traitement HDR", mis à part le fait qu'il est basé sur une luminosité maximale donnée? comment fonctionne-t-il?

J'ai quelques bonnes connaissances en photo, où le HDR est apparu bien avant qu'il en soit question en vidéo. De façon schématique et résumée, il s'agissait de déboucher les parties sombres et d'assombrir les parties claires d'une image pour faire ressortir plus de détail dans les parties bouchées (trop sombres) ou brulées (trop claires). Cela n'était possible que quand l'orignal (raw) contenait des données exploitables. Au début du HDR "photo" le but était de se rapprocher de ce que l'oeil pouvait percevoir "en live". Puis avec le temps certains photographes se sont amusés à exagérer cet effet, donnant ainsi des images surréalistes mais dont l'effet plaisait beaucoup. Le HDR "photo" s'est alors appuyé sur des prises de vue multiples quasi simultanées, à des valeurs d'exposistion étagées pour capter un maximum de détails en zones très sombres comme très lumineuses, puis en combinant ces images pour offrir des rendus très spectaculaires, mais bien éloignés de ce que l'oeil perçoit. On aime ou pas, c'est une autre histoire.

Mais qu'en est-il en vidéo?

S'il s'agit simplement de restituer les valeurs et nuances d'un original scanné ou filmé (transfert), pourquoi parler de HDR? Un bon étalonnage sur toute la chaîne de production jusqu'à la diffusion devrait suffire, non? L'aptitude à restituer un nombre important de nuances de gris ne dépend-elle pas de la construction même de la dalle, plutôt que d'une surcouche logicielle?

Je vois bien la différence à l'oeil (j'ai un 65C8 et un lecteur BD UHD DV, Netflix et Prime vidéo), mais je trouve que c'est surtout au niveau de la luminosité des parties les plus claires que la différence entre HDR et SDR est visible. L'apport en zone sombre me paraît moins flagrant.

Crazy V a écrit:Quant au DV par rapport au "simple" HDR, personnellement je ne vois pas la différence...

Enfin, qu'en est-il techniquement du passage d'un support HDR10+ (dynamique comme le DV) en HDR10? (ou DV vers HDR10, ce qui revient peu ou prou au même)?

Si j'ai bien compris, le HDR10"+", tout comme le Dolby Vision sont des formats HDR dynamiques qui font varier l'incidence du traitement HDR en fonction de chaque scène, contrairement aux autres formats HDR qui, eux, sont statiques. Voilà ce que j'ai lu, mais précisément, quand un contenu HDR10+ est restitué en HDR10, sur quelle valeur "statique" se base-t-il? Est-ce une valeur inscrite dans le fichier, ou calculée par le diffuseur?

Beaucoup de questions, mon post peut paraître un peu culottéMais qui ne tente rien n'a rien

et merci en tous cas pour tout éclaircissement que je pourrais trouver ici!

pour la mise au point générale et les infos détaillées, que je vais prendre le temps de lire, y compris les liens.

pour la mise au point générale et les infos détaillées, que je vais prendre le temps de lire, y compris les liens.

|

|