Jean-Pierre Lafont a écrit:Pio2001 a écrit:En audio, on fait très rarement des tests ABX pour obtenir des statistiques. Généralement, c'est pour déterminer si une différence est formellement audible entre deux appareils pour une personne donnée.

Le test JBL est pourtant un exemple de test ABX à des fins statistiques. Les normes sont souvent établies d'après des expériences comparatives menées au fil du temps sur un grand nombre de sujets. Le temps de réverbération des pièces d'écoute a été établi de cette façon. Le niveau d'écoute des salles de cinéma aussi.

Tout-à-fait. Et les université aussi, parfois, ainsi que l'AES.

Mais on trouve un grand nombre de tests de type purement ABX, dans lesquels on a coutume de faire répéter l'identification à un seul auditeur jusqu'à obtenir un résultat significatif. David Clarke, l'association espagnole Matrix-Hifi, et sur HCFR, l'équipe des Kangourous, en ont fait de nombreux.

jacko a écrit:Tester en ABX des systèmes dans lesquels plusieurs éléments changent ?

Ce test avait été précédé d'une vingtaine d'autres, étalés sur plusieurs mois ou années, dans lesquels un seul élément était changé à chaque fois. Et quasiment à chaque fois les auditeurs ne parvenaient pas à faire de différence. Pour différencier en ABX deux lecteurs de CD, il avait fallu descendre jusqu'au baladeur CD, en face d'un système à base de DAC Audio Note, je crois. Enfin une différence avait pu être mise en évidence en ABX... en faveur du baladeur !!!

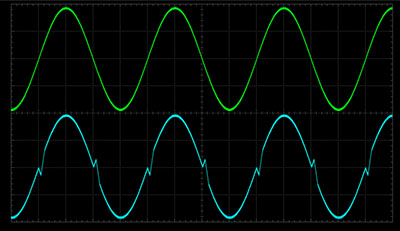

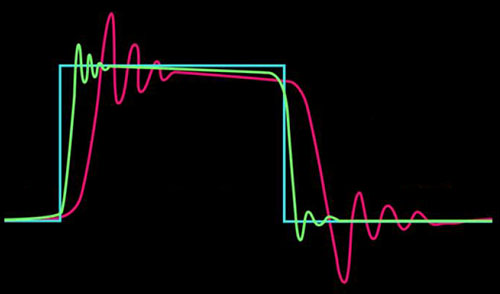

Et le pire, c'est que les mesures expliquent la chose ! Un baladeur CD a logiquement une meilleure réponse en fréquence qu'un DAC Audio Note, de conception ésotérique (lampes, et filtre anti-alias imparfait).

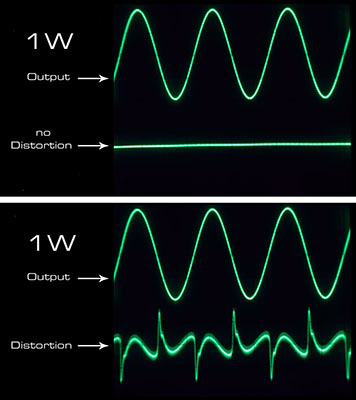

Pareil pour les amplis. ils avaient beau comparer les extrêmes les plus fous, les tests échouaient toujours.

C'est le résultat de tous ces tests (malheureusement disparus de leur site web) qui les a conduits, à la fin, à tout changer d'un seul coup : supports, câbles, source et électroniques... pour le résultat posté plus haut. Ils ne l'ont pas fait en ABX car cela aurait été redondant avec tous les tests ABX qu'ils avaient déjà faits auparavant. Ils ont juste demandé aux participants de voter. De cette façon, ils ont contourné l'argument selon lequel leur pièce ou les enceintes utilisées n'étaient pas assez discriminantes.

jacko a écrit:A mon avis les choses sont souvent très mal faites.

jacko a écrit:La statistique est le seul élément probant et ne peut se faire que sur un échantillon (panel) représentatif [...] Il ne faut pas réfléchir bien longtemps pour se rendre compte qu'un petit groupe ne peut pas déterminer une conclusion valable.

J'ai l'impression qu'on ne parle pas de la même chose. Plus haut, Fyper disait qu'on ne peut tirer aucune conclusion d'un test ABX échoué. Or, toutes les conditions dont tu parles, si elles étaient réunies, permettraient justement de conclure à une absence de différence à partir d'un test ABX échoué.

Aucune d'entre elles n'est nécessaire pour tirer une conclusion d'un test ABX réussi. Pour cela, les conditions sont plutôt le nombre d'essais (pour éliminer le hasard), l'absence de répétition (ne pas garder seulement ce qui nous arrange), la mise en double aveugle stricte (pas de triche possible), et la reproduction par une équipe indépendante (tout le monde peut se tromper).

Mais surtout, j'ai l'impression que tu as en tête une vision a priori de ce que tu veux faire dire à un test ABX.

Et étant donné les conditions que tu donnes, cela ressemble à "le test doit pouvoir être accepté pour publication dans le journal de l'AES, et pouvoir faire l'objet d'un article dans Science et Vie, sinon, cela n'a strictement aucune valeur".

Ce n'est pas du tout dans ce contexte qu'on pratique les tests ABX "chez soi". Chez soi, on utilise le protocole ABX comme on utilise un voltmètre pour savoir si une pile est encore bonne.

Et tes arguments, transposés à l'analogie du volmètre, ressemblent un peu à "on ne peut tirer strictement aucune conclusion du fait que l'aiguille d'un voltème soit placée en face de la graduation 1.5 V".

Effectivement, le calibre du voltmètre était-il le bon ? Est-ce qu'on ne s'est pas trompé de pile ? A-t-on tenu compte de l'imprécision du voltmètre ? Les fils étaient-ils fermement appliqués aux bornes de la pile ? etc.

Pour autant, doit-on en conlure qu'utiliser un voltmètre pour tester une pile ne sert strictement à rien et qu'on ne peut en tirer aucune conclusion ?

et avec les élèves de mon cour de Prise de Son les locaux étaient traités .

et avec les élèves de mon cour de Prise de Son les locaux étaient traités .